前編では、「動画」の構成要素とその一つである「映像」について解説しました。動画配信には「コーデックにより圧縮された映像」が使用されていることもお伝えしましたが、残りの構成要素である「音声」と「コンテナ」はどのように使用されているのでしょうか?

▼前編はこちら

後編では「音声」と「コンテナ」について解説し、「動画」について迫っていきます。

1. 「音声」とは?

音声とは、空気などを介して人の耳に伝わる振動を指します。音声を発生する楽器や人の声帯などの音源の振動が、周りの空気や物質を媒質とした波として伝わり、その波の振動が人の耳には音声として認識されます。この波の振動をそのままの波形で伝送する電磁的な信号をアナログの音声信号と呼びます。

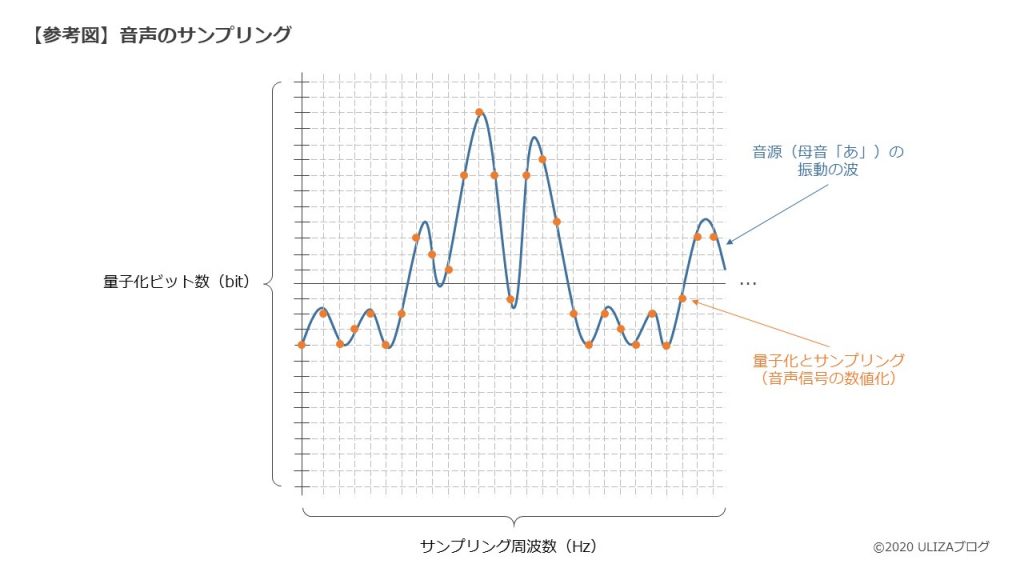

そして、アナログの音声信号をデジタル化するためには、「サンプリング」と呼ばれる、一定間隔ごとにその音声信号を数値化する処理が必要になります。1秒間あたりに行うサンプリングの回数を「サンプリング周波数」または「サンプリングレート」と呼び、その単位として「Hz」を用います。また、サンプリングの際の数値化の精度を「量子化ビット数」と呼び、その単位として「bit」を用います。

では、前編の映像と同じく1時間の音声があるとして、一体どのくらいのデータサイズになるのでしょうか?今回も細かい説明は省略しますが、CDと同等品質の音声を例に、簡単に計算してみたいと思います。

条件

・サンプリング周波数:44.1kHz(44,100Hz)

・量子化ビット数:16bit(2byte)

・チャンネル数:ステレオ音声(2ch)

・音声尺:1時間(3,600秒)

計算式

・ビットレート

44,100(Hz) × 2(byte) × 2(ch) ≒ 1.35Mbps

また、データサイズは以下のようになります。

・データサイズ

44,100(Hz) × 2(byte) × 2(ch) × 3,600(秒) = 約606MB

このデータサイズ 約606MBというのは、一般的なデータ用CD1枚に収まるサイズ(※)となり、それほど大きくないと感じる方もいらっしゃると思います。

※

一般的なデータ用CDの容量は650~700MBとなっていますが、音楽用CDはエラー訂正用データ等を含まないため、データ用CDと比べると約1.15倍の記録が可能になっています。容量650MBを例に音楽用CDの収録時間を計算してみると、以下の通り、約74分の収録が可能です。

(650MB × 1.15) ÷ 1.35Mbps ≒ 74分

実はこの収録時間は、ベートーヴェンの交響曲第9番が1枚に収められるよう、このような規格に設定されたと言われています。

しかしながら、1.35Mbpsというビットレートは、一般的に普及している音楽配信サービスで高音質の音楽のビットレートとして採用される320kbpsと比較すると数倍の大きさです。では一体、どのようにパソコン・スマートフォンでの音楽配信を可能にしているのでしょうか?やはりここでも映像と同様に、「圧縮技術」の活躍が隠されているのです。

音声の「圧縮技術」とは?

映像の場合と同様に、音声の圧縮技術も「コーデック」と呼ばれ、有名なところでは、DVDや地デジなどで利用されるMPEG-2 AAC、Blu-rayや多くの音声配信・動画配信サービスで利用されるMPEG-4 AACなどが挙げられます。

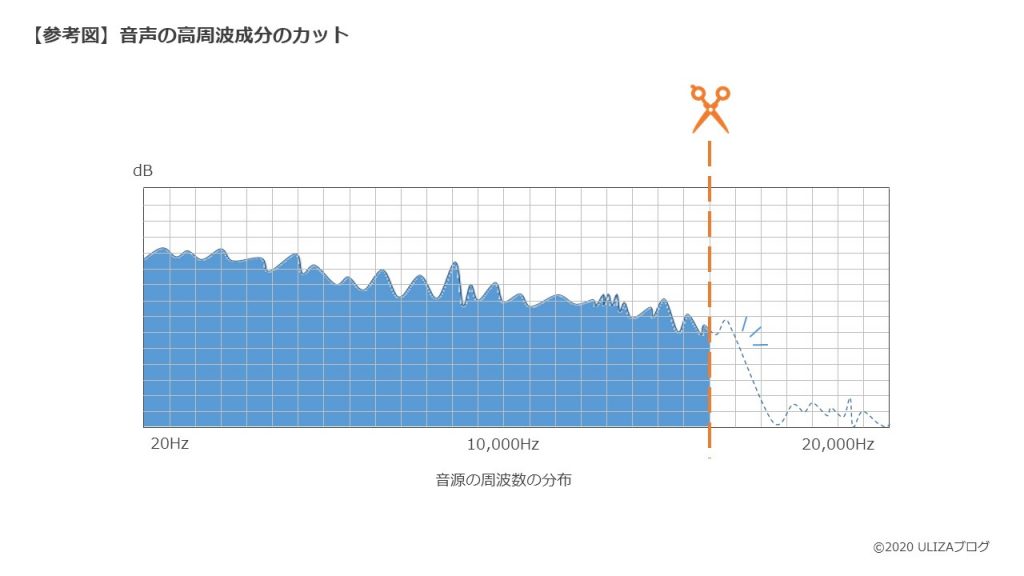

音声のコーデックにも、人の聴覚では認識されにくい高周波成分のカットなど、音声に特有の性質を利用した効率的なデータ圧縮の仕組みが取り入れられています。

過度な圧縮は、いわゆる高音域の「シャリシャリ音」など、音声品質の劣化に繋がりますので注意が必要です。

2. 「コンテナ」とは?

コンテナとは、映像や音声のインターネットでの配信、電波やケーブルでの伝送、またはメディアへの記録を行いやすくするために、これらを一つにまとめて格納する「入れ物」を指します。コンテナの形式は「多重化形式」や「ファイルフォーマット」などと呼ばれます。

「とりあえずコンテナなるものが利用されているのは分かったけど、結局何に利用されているの?」とお思いの方も多いでしょう。コンテナを利用する主な目的を、以下に説明します。

コンテナの利用目的

(1) 多重化

ばらばらになっている映像データと音声データを合わせて一つの動画データにまとめる処理を、多重化と呼びます。「マルチプレクス」または「マックス」と呼ばれる場合もあります。

多重化を行う理由として、映像と音声をずれることなく同期させた形で配信・再生するためには、通常は映像と音声がばらばらになっているよりも一つにまとまっている方が都合が良いためです。

例えば、パソコンで動画を再生する際に「プレイヤーから映像データと音声データを個別に指定して再生を開始する必要がある」という状況は、とても不便だと思いませんか?個別指定では再生開始のタイミングを合わせることが難しく、映像と音声がずれて再生されると、とても違和感がありますよね。

多重化には映像と音声の他に、字幕などのデータも一緒にまとめられる場合もあります。

(2) 補足情報の付与

付与される補足情報にはさまざまな種類があり、以下に代表的なものを紹介します。

・映像コーデックや音声コーデックの種類とパラメタ設定値

圧縮映像・圧縮音声データを直接読み取ることなく、前もってそれらに関する情報を判別し、適切に再生に必要な処理の準備を行うために用います。

の付与-1024x576.jpg)

・ランダムシークのためのインデックスやタイムスタンプ

あらかじめデータ内のどこに何が、つまりどのアドレスにどの再生位置があるかを知るために用います。

の付与-1024x576.jpg)

・DRMに関する情報

動画を再生するためにどのようなDRM処理をすれば良いかを知るために用います。

の付与-1024x576.jpg)

・動画の内容に関するメタ情報

動画のタイトルや著作権情報など、動画の再生とは直接関係ない情報を付与することが可能です。

の付与-1024x576.jpg)

3. 「動画」ってこういうもの

後編では、「動画」の構成要素の一つである音声に関する圧縮技術について解説し、動画配信には「コーデックにより圧縮された音声」が使用されていることもお伝えしました。また、コンテナが重要な役割を担っていることもお分かりいただけたかと思います。

改めてお伝えすると、動画とは一般に、別々のデータである「映像」と「音声」を「コンテナ」に収納したデータを指します。そして、パソコン・スマートフォン向けの動画配信サービスを行うためには、その映像データと音声データが「コーデックにより圧縮」されている必要があります。

コーデックによる圧縮は、その仕組みの複雑さや動画の品質そのものに影響を与えるという観点から、難しい印象を持った方もいらっしゃると思います。とはいえ、昨今では様々なツールやサービスの普及により、例え本記事のような動画の構造を知っておかなくても、比較的簡単に動画を取り扱えるようになっています。特に、企業向けの有料動画配信プラットフォームには無償のサポートサービスによる技術支援を受けられる場合が多いので、動画配信の利用用途に合わせて使い分けてみるのもいいですね。

.jpg)

-160x160.jpg)